Home » Técnicas »

GRACIÓN DIGITAL

Por Paul J. Stamler

¿Cómo funciona la grabación digital del sonido? Pensamos en el audio digital principalmente como una forma de manipular los sonidos, pero no es así como comenzó. Originalmente, la idea era hacer que las señales de audio fueran menos vulnerables a la corrupción.

Como muchas otras cosas en el audio, la grabación digital del sonidosurgió de una investigación realizada por The Phone Company. Capitalicé esas palabras porque, hace mucho tiempo, en la mayoría de los Estados Unidos solo había una compañía telefónica: AT & T / Bell Telephone.

Audio Digital

- Guía completa para la grabación del bajo

- Invirtiendo en equipo para guitarras

- Guitarras en dos caminos, dividir para mejorar

- Mezclar audio profesional grabado en otro estudio

- Concepto básicos de la grabación digital de sonido

- Kiko Loureiro, Consejos de la grabación de guitarras de un virtuoso

- Flujo de señal del estudio de grabación DAW

- Ecualización acústica en la guitarra eléctrica

- Reparto digital de señales

- Mezclando Guitarras, Parte II

De hecho, la primera aplicación práctica de la tecnología que se convirtió en grabación de audio digital fue un sistema llamado SIGSALY, un sistema de comunicación privado (y muy seguro) que conectó a Winston Churchill y Franklin D. Roosevelt durante la Segunda Guerra Mundial. En aquel entonces, la codificación digital de las señales de audio era algo bastante exótico; Ahora se ha vuelto universal.

¿Por qué es útil la grabación digital del sonido?

Para saberlo, debemos echar un vistazo (masivamente simplificado) a cómo funciona.

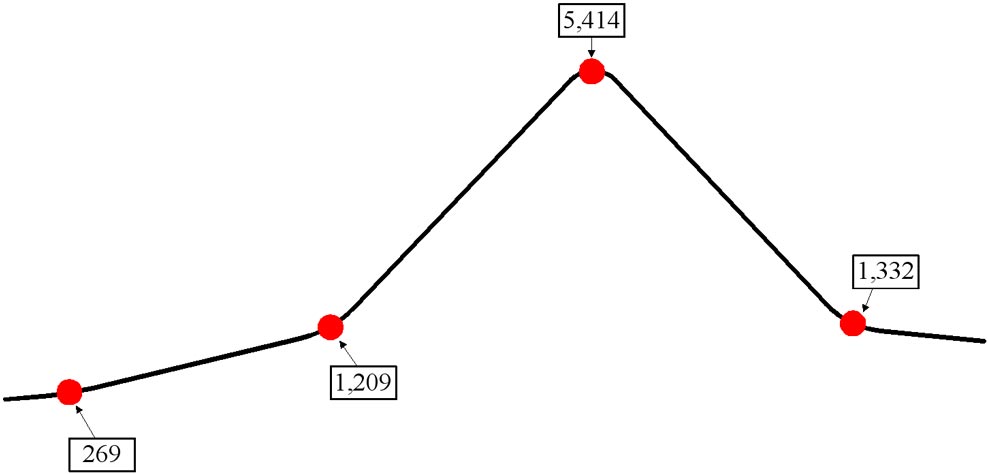

Enla Figura 1 hay un fragmento muy corto de una forma de onda de audio. En realidad, es un gráfico de voltaje (el eje Y) en función del tiempo (el eje X). Este es el tipo de forma de onda que puedes en contrar en la salida de un preamplificador de micrófono, y puedesconvertirlo en una grabación útil de varias maneras.

Puedescortar una ranura con forma de onda en un disco maestro de cera y usarla (a través de pasos intermedios) para hacer discos, como se hizo durante la era de 78 rpm. O puedesusar la forma de onda para variar la cantidad de magnetismo en la bobina del cabezal de registro de una grabadora de cinta, haciendo que la orientación de pequeñas partículas de óxido de hierro en una tira de plástico varíe de una manera que imite los altibajos de la forma de onda. El surco cortado en el disco maestro o el patrón magnético en la capa de óxido será más o menos análogo a los altibajos de la forma de onda, por lo que llamamos esta grabación analógica, y durante el primer siglo de la industria de la grabación fue prácticamente loúnicoque había. La forma del surco sería trazada por una aguja, o la orientación de las pequeñas partículas de óxido sería detectada por el cabezal de reproducción de una grabadora de cinta, y se produciría un voltaje que seguía el voltaje de la forma de onda original. Más o menos.

Procesos no lineales

Estos procesos de grabación también fueron no lineales, lo que mencioné es una forma de un ingeniero de decir que entregaron una versión distorsionada de la señal original.

Los mismos problemas (ruido y distorsión) afectarían una señal cuando pasaba por una línea telefónica o un enlace de microondas de larga distancia, por lo que era natural que la compañía telefónica buscara un remedio.

Figura 1

De otra manera

Los ingenieros de Bell se dieron cuenta de que si, en lugar de transmitir una señal, pudierandescribirla y transmitirla, terminaría con las imperfecciones de la transmisión o, si grababa y reproducía la descripción, las imperfecciones de los medios de grabación. La forma en que eligieron describir la señal fue con números y para hacerlo tuvieron que samplearla señal, lo que significaba medirla a intervalos regulares y derivar un número que representara el voltaje en el momento en que se tomaron muestras de la señal. El dispositivo que hace esto es un convertidor analógico a digital, o un convertidor A/D.

Mirando el fragmento de la Figura 1, la primera muestra podría ser baja, correspondiente al número 269. (¿269 de qué? En este caso, 269 de los diminutos cortes que conforman la señal completa).

En la siguiente muestra, la señal podría ser de 1,209 cortes altos; un momento después, podría ser 5,414, luego podría bajar a 1,332. Si pudierastransmitir esos números (y un montón más como ellos) por un cable a un receptor que registraría los números y produciría un voltaje del nivel correspondiente (un convertidor de digital a analógico o un convertidor D/A), entonces se transmitiríala señal digitalmente – lo único que pasa entre el originador y el receptor del mensaje es un flujo de números. El convertidor de digital a analógico solo reconoce números: el voltaje que emite solo se controla por los números que ve en su entrada.

Por supuesto, cuando envíes los números por la línea, esa transmisión percibiráun poco de ruido en el camino. Pero como el convertidor D/A responde solo a los números, ignorará las fluctuaciones aleatorias de bajo nivel en la línea de transmisión, y el descodificado no tendráruido adicional.

Más allá de la transmisión

Si, en lugar de transmitir los números, encuentrasuna forma de grabarlos y luego reproducirlos, puedeshacer una grabación digital que sea esencialmente impermeable aefectos del medio de grabación: el convertidor D/A solo respondería a los números, y el medio de grabación no agregaría ningún ruido a la señal. En teoría, podríascopiar la señal, luego hacer una copia de la copia y seguir haciéndolo sin captar una pizca de ruido; solo si el ruido fuera tan fuerte que hiciera los números ininteligibles afectaría la señal. Una señal digital es lo que los ingenieros llaman robusto:siemre queel convertidor D/A reciba “269 … 1,209 … 5,414 … 1,332” obtendrá la misma forma de onda en la salida.

Detalles

Por supuesto, como estoy seguro de que saben, el audio digital realmente no usa números en notación decimal (base-10), porque los circuitos electrónicos realmente no los manejan muy bien. Si los números se traducen a notación binaria (base 2), los circuitos son mucho más felices. Así, 269 se traduce como 100001101;5,414 se expresa como 1010100100110 y 1,332 se convierte en 10100110100. Cada uno de esos cerosy unoses un dígito binario, abreviado como bit.

¿Por qué es útil el binario? Cada uno de los bits se puede expresar como algo que es una de dos alternativas; un transistor se puede encender o apagar, un pedazo de cinta magnética (o disco duro) puede tener un punto donde todas las partículas de óxido están orientadas en una dirección o en la dirección opuesta, un medio óptico puede tener un punto o ningún punto en un ubicación particular, etcétera. (El difunto Mike Seeger solía referirse al audio digital como el “método de grabación de sí o no”.) Ese carácter de todo o nada significa que los dispositivos digitales tienden a ignorar pequeñas desviaciones; solo prestan atención a la información directa. Como esas pequeñas desviaciones son lo que llamamos ruido y distorsión, eso significa que un sistema que expresa información digital de manera binaria es inherentemente bueno para separar lo que se desea (números) de lo que no es (fluctuaciones aleatorias).

Más detalles

Ahora se pone complicado. Notarás que solo se necesitaron nueve bits para codificar 269, pero 13 bits para codificar 5,414. (Cuéntalos). Nueve bits pueden codificar cualquier número desde (decimal) 0 a 511, pero diez bits pueden codificar números tan altos como 1,023 (más cero) y dieciséis bits pueden codificar hasta 65,535 (más cero). En efecto, la cantidad de bits indica qué tan delgada es la porción que puede resolver un sistema digital y, por lo tanto, qué tan sutilmente puede diferenciar el sistema entre diferentes niveles. (A esto le llamamos la profundidad de bits.) Los discos compactos usan 16 bits.En la actualidad, los sistemas de grabación profesional utilizan 24 bits, que en teoría pueden codificar 16,777,216 niveles (incluido el cero).

De analógico a digital

¿Qué sucede si el codificador, o el convertidor analógico a digital, obtiene un voltaje de entrada que se encuentra precisamente entre dos niveles, por ejemplo, 268.5 en lugar de 269? Bueno, 268 (en un sistema de 16 bits) se traduciría 0000000100001100, pero 269 se traduce como 0000000100001101. Ninguno es exactamente correcto, pero el sistema debe elegir uno (decimos que el sistema está cuantificado, lo que significa que solo puede expresar ciertos niveles fijos) . Se elegirá esencialmente al azar, y la aleatoriedad, en la electrónica, generalmente significa ruido. Por lo tanto el ruido creado por un sistema sampleadose llama, razonablemente, ruido de cuantificación. (Los sistemas digitales reales usan algo llamado dither para suavizar la cuantización, pero van más allá de lo que abarca esta serie. Solo piensaen esto como magia: una señal aleatoria muy pequeña que hace que los sistemas digitales se comporten correctamente en niveles bajos).

Ruido de cuantización

El nivel de ruido de cuantización controla la cantidad de rango dinámico que tiene el sistema. Está controlado por la profundidad de bits y es, en teoría, igual a 6dB veces el número de bits. Por lo tanto, un sistema de 16 bits tiene un rango dinámico teórico de 96dB, mientras que un sistema de 24 bits tiene un rango dinámico teórico de 144dB.

Como mi gurú dijo una vez: “En teoría, no hay diferencia entre la teoría y la práctica. En la práctica, sí hay “. Lo mismo ocurre con el rango dinámico y la profundidad de bits.Los sistemas de 16 bits del mundo real generalmente tienen rangos dinámicos reales de aproximadamente 92dB, mientras que los sistemas de 24 bits del mundo real tienen rangos dinámicos del mundo real de entre 110dB y 120dB.

Sistemas digitales

El breve mensaje de los párrafos anteriores es que un sistema digital traduce los voltajes que sampleade la forma de onda original a números digitales.Los sistemas con más bits pueden discernir distinciones más finas entre niveles y son más silenciosos. Los teóricos sostienen que una mayor profundidad de bits solo hace que la señal sea más silenciosa, pero aquí la distinción de mi gurú entre la teoría y la práctica entra en juego: la mayoría de los ingenieros de audio dirán que la diferencia entre las señales de 16 y 24 bits es claramente audible como una diferencia de claridad. y detalle. ¿Por qué la discrepancia? Bueno, es importante recordar que la conversión ocurre en el hardware, y el hardware vive en el mundo real. Es posible que estemos escuchando las limitaciones de ese hardware del mundo real en lugar de una diferencia teórica. No lo sé, pero sí sé que los ingenieros de estudio, que también tienen que vivir en el mundo real, graban casi inevitablemente con 24 bits. (¿Qué pasa con los archivos de 32 bits que se ofrecen como opción en muchos sistemas DAW? Resulta que estos no son realmente 32 bits; y sí una forma de formatear números de 24 bits que los hace más fáciles para trabajar con una computadora. La señal de audio todavía se divide en segmentos de 24 bits.)

PCM

Este sistema de codificación, que digitaliza la señal analógica en palabras codificadas en binario, se llama modulación de código de pulso, o PCM. Se utiliza para la grabación de audio y las transmisiones telefónicas en todo el mundo, y en este momento un sistema PCM está ocupado transmitiendo imágenes de Plutón al planeta Tierra. El principio básico de PCM es que (para simplificar) la conversión A/D se realiza con precisión, si la conversión D/A se realiza con precisión, y si lo que hay entre (un sistema de almacenamiento o transmisión) entrega los números correctos en en el momento adecuado, puede reproducir honestamente la forma de onda de la señal original.

Tiempo en una botella

Acabo de mencionar el tiempo porprimera vez. He hablado hasta ahora sobre cómo se corta la señal de audio en el eje vertical, lo que representa qué tan grande es la señal de audio con los números (la esencia de la grabación digital del sonido). Algo igualmente crucial para definir cómo un convertidor convierte las formas de onda analógicas en números es cuándomide el eje horizontal. La velocidad a la que se sampleala forma de onda se llama, lógicamente, la frecuencia de sampleo.

Los discos compactos utilizan una frecuencia de sampleo de 44.100 muestras por segundo, mientras que la mayoría de los formatos de video toman muestras de la porción de audio a 48.000 muestras por segundo, y el audio de “alta densidad” a menudo toma muestras de 96.000, 192.000 óincluso 384.000 samplespor segundo. ¿Por qué tan alto?

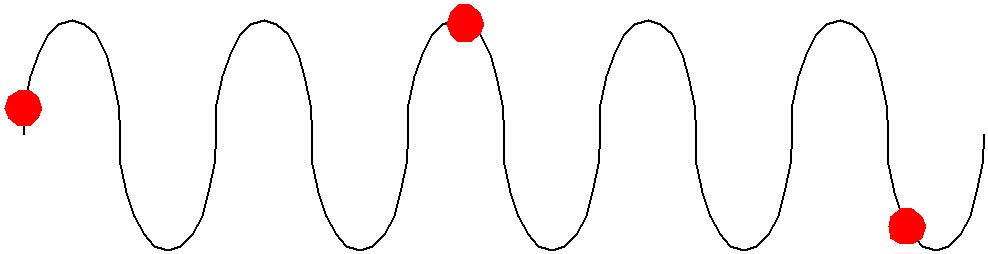

Figura 2

Frecuencias de sampleo

Aparentemente sin relación: las frecuencias de sampleo se describen a veces como “44.1 kHz” (para CD), “96 kHz”, etc. Esto es técnicamente incorrecto; estamos hablando de samplespor segundo, mientras que “Hz” significa ciclos por segundo. Pero el hábito persiste en referirse a las frecuencias de sampleo como “kHz”, y aunque no es literalmente correcto, los ingenieros de audio lo siguen haciendo. ¿Por qué?

La respuesta es que aunque está mal, no está completamente equivocado. Para explicar por qué, necesito tomar un desvío bastante amplio.

Conectando los puntos

De vez en cuando, un novato en la grabación de audio me llega con el descubrimiento de que la grabación digital no puede funcionar. Inevitablemente, me muestran un dibujo como el de la Figura 2, que muestra una forma de onda analógica que está siendo sampleadapor un convertidor de analógico a digital.Los puntos de muestra se sampleande nuevo como puntos rojos. Si luego tomas los puntos rojos (samples) y los conviertes de nuevo en audio analógico, descubres que hay una ambigüedad.Los puntos se pueden reconstruir de más de una manera. La Figura 3 muestra una posible forma de onda que se puede hacer a partir de los puntos.

Esa forma de onda no se parece en nada a la original. ¿Entonces mi interlocutor tiene razón? ¿Es imposible la grabación digital? Un posible problema es que la pregunta realmente implica la imposibilidad de cualquier proceso de audio que implique sampleo.Convertir las muestras en números y luego volver a formas de onda analógicas es solo un detalle. Pero como el sampleo es una característica integral del audio digital, en términos prácticos este argumento es, en esencia, una refutación de la posibilidad del audio digital.

Figura 3

Sorpresa

Y aquí está la sorpresa: el argumento es completamente válido. Su alcance, sin embargo, es menos que universal; la realidad es que no puede samplear(y, por lo tanto, digitalizar) esa forma de onda con esos puntos de muestra. De lo contrario, el sistema creará esas frecuencias ambiguas que no están en la señal original; eso se llama aliasing.

De hecho, para samplear(y digitalizar) una forma de onda a una frecuencia determinada, las muestras deben tomarse a un mínimo de dos veces esa frecuencia, de modo que cada ciclo de la señal (o cualquiera de sus componentes armónicos), se sampleeal menos dos veces. Si nos fijamos en la Figura 2, las muestras son menos frecuentes que eso; de hecho, en ese ejemplo, la frecuencia de sampleo es en realidad más baja que la frecuencia de la señal.

Este principio, que un sistema basado en sampleo solo puede funcionar correctamente para señales de menos de la mitad de la frecuencia de sampleo, se demostró matemáticamente en 1928 por el ingeniero Harry Nyquist, y el principio generalmente se conoce como el Teorema de Nyquist (aunque, para ser justos los otros ingenieros y matemáticos que lo desarrollaron de forma independiente, bien podría llamarse Teorema de Whittaker-Nyquist-Küpfmüller-Kotel’nikov-Whittaker-Raabe-Gabor-Shannon.) Y se conoce la frecuencia que es la mitad de la “frecuencia de sampleo”. como la frecuencia de Nyquist.

En el mundo real

Dejando los nombres a un lado, establezcamos nuevamente el principio básico, porque es realmente importante: nunca puedes samplearcon éxito señales de más de la mitad de la “frecuencia de sampleo”. Las señales de mayor frecuencia están fuera de los límites, como un balón de fútbol. Es por eso que los ingenieros de audio lo siguen llamando “frecuencia de sampleo”, en lugar de la “razónde sampleo” que sería lo más correcto.Cuando se piensa en la Frecuencia Nyquist, es útil saber que siempre es la mitad de la “frecuencia de sampleo”. Y es por eso que tiene cierto sentido de acierto de los bajos pensar en la frecuencia de sampleo como una frecuencia.La mitad de una frecuencia es una frecuencia.

En la práctica

Hay unaspecto práctico entodo esto: un sistema de grabación digital debe evitar que las señales fuera de los límites ingresen al convertidor de analógico a digital, lo que significa que los diseñadores deben incluir un filtro de paso bajo muy pronunciado justo por debajo de la frecuencia de Nyquist. Entonces, si la frecuencia de sampleo es de 44.100 muestras por segundo, la frecuencia de Nyquist será de 22.050 Hz; el filtro debe tener su frecuencia de corte de aproximadamente 21,000Hz, y debe ser lo suficientemente inclinado para que la respuesta sea atenuada a unos 90dB por la frecuencia de Nyquist de 22,050Hz. Estos son (razonablemente) conocidos como filtros anti-aliasing.

Esees un atractivode las tasas de sampleo más altas como 96k Hz y más: los filtros de paso bajo pueden ser menos drásticos. Los filtros extremadamente empinados saltan muchocon la fase y la respuesta de impulso de las señales, y una frecuencia de sampleo que te permite utilizar un filtro menos pronunciado distorsiona menos la forma de onda.

Además, una frecuencia de sampleo más alta te permite grabar sonidos de mayor frecuencia. La sabiduría convencional afirma que los humanos, incluso los humanos jóvenes y sanos, no pueden escuchar a más de 20 kHz, pero hay algunos sonidos . Esos sonidos, pueden decir cuando faltan. Así que las tasas de sampleo más altas (96,000 muestras/segy más) siguen siendo populares. Algunos ingenieros, si saben que se mezclará en una consola analógica, realizarán una gragación a 96 k, luego mezclarán en un formato con una frecuencia de sampleo más baja para lazamientoen un CD o descargas. A 96.000 muestras/seg. La tasa permitirá grabar justo por debajo de su frecuencia Nyquist de 48 kHz.

Figura 4

¿Si no es ahora, cuando?

Mientras hablamos sobre cuándo se realiza el sampleo, es realmente importante que las muestras se tomen en el momento adecuado. Ver Figura 1,donde la forma de onda sampleadaproduce los números 269… 1,209… 5,414… 1,332. Digamos que la primera muestra pasa un poco antes; la forma de onda está aumentando en ese punto, por lo que una muestra temprana podría medir 268 en lugar de 269. Imaginaque la última muestra también es un poco pronto.Debido a que la forma de onda estádisminuyendo en ese momento, una muestra temprana podría salir como 1,334 en lugar de 1,332. Ponlotodo juntoy la secuencia se convierte en 268… 1,209… 5,414… 1,334. Y eso es distorsión.Los primeros y últimos números son incorrectos, porque las muestras se realizaron en los momentos equivocados.

La variación en el tiempo de sampleo es un fenómeno muy real en los sistemas de sampleo digital, y se llama fluctuación de fase. ¿Qué mantiene el jitteral mínimo? En primer lugar, un reloj preciso; de hecho, una de las grandes diferencias entre los convertidores de grado de consumo y de grado profesional es que las unidades profesionales se especifican como con menor fluctuación de fase, a veces mucho más baja.

Y sale aquí

Cuando una señal codificada en PCM sale de un convertidor digital a analógico, se ve como la Figura 4. Puedesver que la señal estásaliendo en unidades discretas, cuantificadas en el tiempo (el eje horizontal), correspondientes a las muestras individuales, sus niveles también se han cuantificado (el eje vertical). Por razones obvias, los ingenieros llaman a esto una forma de onda escalonada. Las rápidas transiciones entre niveles son señales ultrasónicas (demasiado altas para escuchar), que pueden causar distorsión más adelante en la cadena de audio. La mayoría de los convertidores D/A filtrarán el material ultrasónico utilizando un filtro de paso bajo con una frecuencia de corte justo por encima del rango de audio, dejando una forma de onda suave. Estos son conocidos como filtros de reconstrucción. Nuevamente, si la frecuencia de sampleo es mayor, el filtro de reconstrucción puede ser menos drástico (por lo general, una pendiente menos pronunciada, que tendrá una mejor respuesta de fase y transitoria, todo para el bien).

Así que esa es la cadena de señal para un sistema de audio digital mínimo:

Entrada> Filtro anti-aliasing> Convertidor A/D> Almacenamiento / transmisión> Convertidor D / A> Filtro de reconstrucción> Salida

Por supuesto, hay mucho más en juego.Hablaremos de eso en los próximos meses. Hasta pronto.